Själv är bäste utrotare

Mänskligheten har kommit så långt att vi inte längre behöver oroa oss för att naturen ska utrota oss. Vi kan göra det själva.

The Precipice startar med en nära döden-upplevelse. Under Kubakrisen 1962 befann sig fyra kärnvapenbestyckade sovjetiska ubåtar runt ön. USA släppte sjunkbomber för att tvinga upp båtarna till ytan samtidigt som luften höll på att ta slut ombord. Någon radiokontakt med Moskva hade de inte; kanske hade kriget redan börjat däruppe? I det pressade läget ville kaptenen på en av ubåtarna avfyra sina kärnvapen. En enda officer stoppade honom och avvärjde katastrofen.

Toby Ord vill ge oss en klar bild av de risker som hotar mänsklighetens överlevnad, ”so that we will make the choices necessary to safeguard our future”. Det är moget och rationellt tänkt, men jag frestas redan att komma med min första invändning. Vi har en ganska klar bild av hur vi borde hantera coronaviruset – har det hjälpt Trump att fatta de nödvändiga besluten? Politiken visar oss, gång på gång, att kunskap inte är allt.

Ord, som är född 1979 i Australien, är etikfilosof vid Oxforduniversitetets Future of Humanity Institute. Han vill att vi ska ägna mer uppmärksamhet åt storskaliga existentiella hot. Det internationella organ som övervakar avtalen om biologiska vapen, skriver han, har mindre budget än en genomsnittlig McDonald’s-restaurang.

I The Precipice går han igenom allt som skulle kunna sätta punkt för mänsklighetens historia: stora asteroidnedslag, gammablixtar från kolliderande neutronstjärnor, klimatförändringar, supervulkaner, genteknik, urspårad artificiell intelligens. Ett 70-tal specialister på allt från biologi till ekonomi har hjälpt honom under arbetet. Kärnvapnen är det knappt någon som oroar sig för längre, men det finns fortfarande 7 000 aktiva stridsspetsar i världen, påminner Ord; fullt tillräckligt för ett avskedsfyrverkeri.

Ord är en filosof av det slag som tycker om att sätta siffror på sådant som är svårt eller omöjligt att kvantifiera. Risken för kärnvapenkrig under Kubakrisen uppskattar han till mellan 10 och 50 procent, men en siffra med så stor felmarginal är inte särskilt meningsfull.

”Å ena sidan är Ord rädd för artificiell intelligens. Å andra sidan är hans förhoppning om att mänskligheten ska kolonisera stjärnorna identisk med transhumanisternas. Hur går det ihop?”

När han har summerat alla risker kommer han fram till att sannolikheten för att mänskligheten går under de närmaste 100 åren är en på sex – lika stor som om vi spelade rysk roulette med en kula i revolvern. De hot han bedömer som allvarligast är de som beror på oss själva, och som vi själva kan förhindra. Svårigheten, skriver han, är den växande klyftan mellan vår teknologiska makt och vår mentala mognad. Det är inte vilken rysk roulette som helst: det är ett gäng barn som leker med revolvern.

När USA förberedde det första kärnvapenprovet (”Trinity”, i juli 1945), fanns det en viss osäkerhet om vad som skulle hända. I explosionens centrum skulle det bli över 15 miljoner grader varmt – samma temperatur som längst inne i solen. En av de ledande forskarna, Edward Teller, varnade för att det skulle kunna utlösa en okontrollerad fusionsreaktion av samma slag som inuti solen. Kunde de vara säkra på att de inte satte eld på världen? Beräkningarna för att avgöra sannolikheten för en global fusion fortsatte ända fram till dagen för provet. Det visar vilka risker människor är beredda att ta, menar Ord. Ljusblixten från bomben var så stark och långvarig att en av åskådarna, Harvarduniversitetets rektor James Conant, trodde att det värsta hade hänt.

Att läsa The Precipice i coronatider är lugnande, på ett kärvt och realistiskt vis. Det är lätt att överskatta den skada som epidemier kan ställa till med, skriver Ord. Spanska sjukan, som bröt ut i slutet av första världskriget, dödade fler människor än de båda världskrigen tillsammans, men det var krigen – som vi själva var ansvariga för – som förändrade världen. Mellan en fjärdedel och hälften av Europas befolkning kan ha dött i digerdöden utan att det medeltida samhället kollapsade. Mot det kan man förstås invända att den tidens jordbruksbaserade civilisation var mer robust än vår högteknologiska.

Bokens stora förtjänst är att Ord aldrig är ute efter att skrämma sina läsare. Han tar klimatförändringarna på allvar, men varje gång några siffror eller slutsatser är osäkra är han noga med att påpeka det. Han erbjuder de hårda siffrornas tröst. Vi kan förlora samtliga pollinerande insekter utan att jordbruksproduktionen sjunker med mer än tre till åtta procent. För 55 miljoner år sedan innehöll atmosfären fyra gånger så mycket koldioxid som idag, utan att medeltemperaturen skenade iväg mot obeboelighet.

Kommer ni ihåg rädslan för överbefolkning? Så här lät det 1969, när Paul Ehrlich varnade för befolkningsexplosionen: ”Sometime in the next 15 years, the end will come – and by ’the end’ I mean an utter breakdown of the capacity of the planet to support humanity.” Sedan dess, skriver Ord, har folkökningen minskat med hälften och fortsätter att falla. 1950 födde varje kvinna i genomsnitt fem barn. Nu är vi nere i 2,47; inte långt från de 2,1 barn som krävs för att befolkningen inte ska minska. Som det ser ut nu kommer världens befolkning att plana ut strax över 11 miljarder människor år 2100. Jag tror inte att det är Ords avsikt, men det får mig att undra hur mycket av vår klimatdebatt som i framtiden kommer att påminna om Ehrlich.

Eftersom hans intressen är så breda, berättar Ord i förbigående en hel del spännande saker. Växternas fotosyntes är beroende av vulkanutbrott som förser atmosfären med koldioxid – till och med vulkaner är viktiga för ekosystemet. Har du hört talas om Norman Borlaug, mannen som påstås ha räddat hundratals miljoner liv? Borlaug tog initiativet till 1960-talets ”gröna revolution” där tredje världens jordbruk försågs med grödor som höjde avkastningen.

Artificiell intelligens är det som gör Ord mest oroad. Tekniken har stått och stampat sedan 1950-talet, men nu håller självlärande system på att närma sig ett genombrott. Här är det lätt att föreställa sig samma accelererande utveckling som på kärnvapnens område: från att ledande fysiker förklarade att kärnvapen var omöjliga dröjde det inte länge till Hiroshima och kalla kriget. Vi behöver ”AI safety research”, säger Ord. Det behöver vi inte alls, säger jag. Inget tvingar oss att utveckla AI om vi inte vill.

Borde vi för säkerhets skull bromsa eller skjuta upp den tekniska utvecklingen, frågar Ord. ”If we pushed back all new risky technologies for a century, that might mean all of us alive today are protected from death in an existential catastrophe.” Han svarar själv: det skulle vara önskvärt, men det finns mer realistiska strategier. Bakom den tankegången ligger en missuppfattning som jag skulle vilja komma tillrätta med.

Vi behöver komma bort från föreställningen att den tekniska utvecklingen är en rät linje, längs vilken vi bara kan röra oss framåt eller bakåt. Antingen tackar vi ja till vad våra självutnämnda herrar i Kalifornien och Kina planerar åt oss, eller så kan vi lika gärna återvända till medeltiden. Istället bör vi föreställa oss utvecklingen som en kompassros eller en expanderande sfär – ”framåt” är 360 grader. Det som vi kallar ”framåt” är bara en smal sektor av alla tänkbara framtider. Säger man nej till artificiell intelligens betyder det inte att man vill stoppa utvecklingen – det betyder att man känner större lockelse från 359 andra spännande framtider, som alla är ”framåt”. Vi har inte ens börjat föreställa oss vad som finns i de andra riktningarna, men det borde vara på tiden. De Silicon Valley-miljardärer som tror att de leder utvecklingen, klarar inte av att använda sina resurser till något mer kreativt än att förverkliga gammal science fiction från 1950-talet: tänkande maskiner, självkörande bilar. De drömmer inte tillräckligt stort.

Vad vi verkligen behöver är inte långsammare utveckling eller forskning om säkrare AI. Vad vi behöver är något som en betydligt mindre tekniskt avancerad civilisation förstod för 2 500 år sedan: Känn dig själv. Gnothi seauton stod det utanför Apollontemplet i Delfi. Det betyder: så länge vi inte förstår oss själva spelar det ingen roll hur teknologiskt mäktiga vi blir. Vi kommer att förbli frustrerade och olyckliga. Vi kommer att kräva att den tekniska utvecklingen ska ge oss ännu mer avancerade presenter, eftersom den förra leksaken inte gjorde oss lyckliga i mer än fem minuter.

Vi behöver förstå våra önskningar, behov och psykologiska drivkrafter. Läs några intervjuer med människor som arbetar med artificiell intelligens och fråga dig hur väl de förstår sina egna motiv. Den teknik som en stressad, olycklig och oreflekterad människa drivs att utveckla behöver inte ha någonting gemensamt med vad som – med Ords uttryck – får mänskligheten att blomstra.

En djurart existerar i vanliga fall mellan 1 och 10 miljoner år. Ur det perspektivet befinner sig människan i tonåren: ”just old enough to get ourselves in serious trouble.” Hästskokrabban har existerat i 450 miljoner år. Vad skulle vi kunna uträtta om vi lever lika länge, frågar Ord. Vi kommer inte att kunna räkna med status quo: vid det laget kommer Afrika att ha delats på mitten på grund av kontinentalplattornas rörelse, och jordklotets rotation har bromsats upp så att ett dygn är 25 timmar.

Populärt

Amnesty har blivit en aktivistklubb

Den tidigare så ansedda människorättsorganisationen har övergett sina ideal och ideologiserats, skriver Bengt G Nilsson.

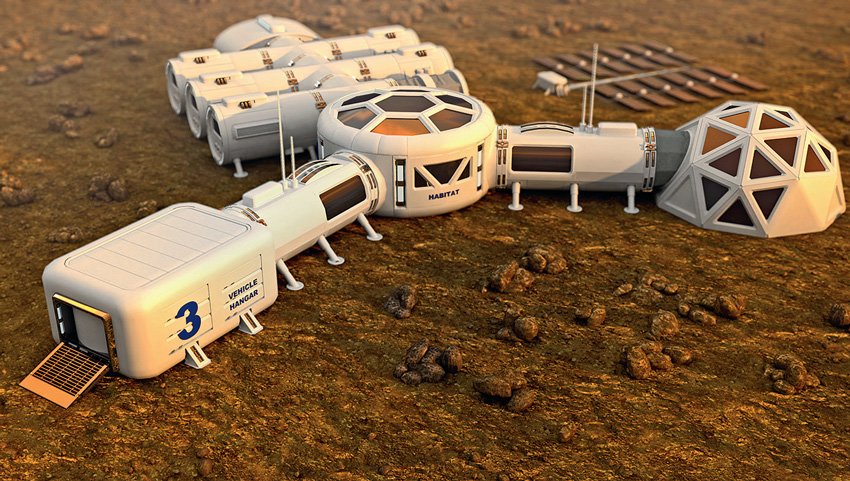

Ord drar ut perspektivet ännu längre in i framtiden: vi skulle kunna lämna den här planeten och kolonisera galaxerna. Han föreställer sig oändligt expanderande framsteg, och ägnar så mycket utrymme åt det som om det vore det enda som gjorde mänsklighetens framtid värd att rädda. Kanske, skriver han, är vi det enda intelligenta livet i universum – ”then responsibility for the history of the universe is entirely on us”. Framtida generationer som nöjer sig med att sitta under korkeken är inget för honom.

Den här framtidsvisionen innebär att The Precipice innehåller en olöst motsättning. Å ena sidan är Ord rädd för artificiell intelligens. Å andra sidan är hans förhoppning om att mänskligheten ska kolonisera stjärnorna identisk med transhumanisternas. Hur går det ihop? Transhumanisterna önskar sig teknologiskt förbättrade kroppar som ska utvecklas bortom det mänskliga; en ledande företrädare är Ray Kurzweil, numera forskningschef vid Google. Människan ska antingen smälta samman med överlägset intelligenta maskiner eller ersättas av dem – det är lite oklart vilket scenario de betraktar som mest önskvärt. I båda fallen är målet en explosion av artificiell intelligens som uppfyller universum.

Vill man ha AI-kritik är det mycket mer givande att läsa Jaron Lanier, förslagsvis Dawn of the New Everything (2017). Lanier är en störigt självständig tänkare som inte är rädd för teknik, eftersom han har befunnit sig vid idéutvecklingens frontlinje ända sedan han var med om att konstruera de första virtual reality-systemen på 1980-talet.

”Humanity is currently in control of its own fate. We can choose our future”, skriver Ord. Det stämmer naturligtvis. Vi är dömda till ansvar, men när jag ser hur människor beter sig i praktiken måste jag fråga mig om vi vill planera vår framtid. Snarare ser det ut som att det är förbjudet för människan att styra sin framtid – framtiden ska liksom bara råka hända. Vi får bara använda vår intelligens till att anpassa oss efter den senaste tekniken, aldrig för att avgöra vilken teknik som skulle vara människovärdig att utveckla. Vilka politiker erbjuder en vision som sträcker sig 100 eller 500 år framåt? Människor vill inte axla det ansvar vi skulle få om vi spelade huvudrollen i vår egen historia; vi föredrar rollen som barn, till hälften oppositionella, till hälften beskyddade. Vi vill leka och bråka i baksätet medan pappa kör bilen. Vi vill satsa hela vår mångsidiga begåvning på att jaga kortsiktiga, egoistiska triumfer, medan vi litar på att någon annan, någon annanstans, tar ansvar för helheten.

Samma invändning uppstod medan jag läste Nick Bostroms Superintelligens (2017), som Ord hänvisar till. Bostrom gör sitt bästa för att varna oss för att vi inte kommer att kunna kontrollera överlägset intelligenta maskiner – men hela poängen med AI är att förlora kontrollen. Människor vill inte ha kontroll. Vi vill ha en förälder, så att vi tryggt kan göra uppror mot varje regel, men ändå känna oss sedda och omhändertagna av någon som är starkare.

Vi kan naturligtvis strunta i de existentiella risker som Ord räknar upp, men det är i så fall ett medvetet val. Mänskligheten har blivit så mäktig att vi är tvungna att välja eller utforma våra egna risker. Det är ingen avundsvärd position.

Journalist och kritiker.